Così Meta etichetterà le immagini generate dall’Ai su Facebook, Instagram e Threads

Etichettatura delle immagini generate dall’intelligenza artificiale su Facebook, Instagram e Threads

di Marco Trabucchi

3' min read

3' min read

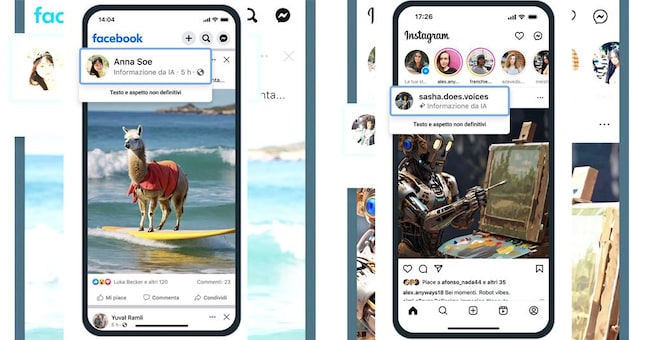

L’industria dell’Ai è ancora indietro nella costruzione di standard comuni per identificare immagini, video e audio generati dall’Ai, ma qualcosa in questo senso si muove. Meta ha già cominciato ad apporre etichette su Facebook, Instagram e Threads nelle immagini create con il proprio generatore, Imagine AI, con la dicitura “Informazione da IA”. Il prossimo passo per l’azienda sarà quello di aiutare le persone a capire quando il contenuto fotorealistico che stanno vedendo è stato creato con l’Ai rilevando ed etichettando, per quanto possibile, le immagini generate dai servizi di intelligenza artificiale da provider terzi come Google, OpenAI, Microsoft, Adobe, Midjourney e Shutterstock.

Spingere gli standard comuni

Misure che secondo Meta sono indispensabili per spingere l’industria tecnologica a creare standard comuni, man mano che i media generati dalle Ai diventano sempre più difficili da distinguere dalla realtà. “Stiamo lavorando con i partner di settore per allinearci su standard tecnici comuni in grado di segnalare quando un contenuto è stato realizzato utilizzando l’Ai. La capacità di rilevare questi segnali ci consentirà di applicare etichette alle immagini generate dall’Ai che gli utenti pubblicano su Facebook, Instagram e Threads applicando le etichette in tutte le lingue supportate da ciascuna app. Questo approccio sarà adottato per tutto il prossimo anno, durante il quale si terranno importanti elezioni in tutto il mondo”, ha dichiarato nella nota per la stampa Nick Clegg, Presidente Affari globali di Meta.A questo proposito Meta dichiara di stare sviluppando strumenti in grado di identificare i contrassegni invisibili delle informazioni generate dall’intelligenza artificiale in modo da poter etichettare le immagini create dagli altri strumenti di generazione Ai, “mentre questi implementano i loro piani per inserire metadati alle immagini create dai loro strumenti”. Secondo Meta questi indicatori “standard” saranno in grado di rilevare l’artificialità delle immagini in maniera automatica. “Stiamo lavorando con impegno per sviluppare classificatori che ci aiutino a individuare automaticamente i contenuti generati dalla Ai, anche quelli che non presentano contrassegni invisibili. Allo stesso tempo, stiamo cercando modi per rendere più difficile la rimozione o l’alterazione delle filigrane invisibili”, ha dichiarato Meta.

La sfida per i video deepfake

Smascherare le immagini fake è un conto, ma quando si tratta di video e audio generati dall’Ai, Clegg suggerisce che è generalmente ancora troppo difficile rilevare questi tipi di falsi, poiché la marcatura e il watermarking non sono stati ancora adottati su scala sufficiente affinché gli strumenti di rilevamento possano fare un buon lavoro. “Non è ancora possibile identificare tutti i contenuti generati dall’Ai, poiché esistono modi in cui le persone possono eliminare i marcatori invisibili - spiega Clegg - Per questo stiamo valutando una serie di opzioni lavorando con impegno per sviluppare classificatori che ci aiutino a individuare automaticamente i contenuti generati dall’Ai, anche quelli che non presentano contrassegni invisibili e allo stesso tempo, stiamo cercando modi per rendere più difficile la rimozione o l’alterazione delle filigrane invisibili”.

La lotta contro i deepfake passerà anche dagli utenti

Per combattere la diffusione di deepfake e audio Ai Meta intende anche responsabilizzare gli utenti, richiedendo a coloro che pubblicano video Ai “fotorealistici” o audio “realistici” di informare che il contenuto è artificiale. Non solo, i contenuti generati dall’Ai potranno anche essere verificati dai partner indipendenti di fact-checking con cui collabora Meta, ed eventualmente contrassegnati in modo da dare alle persone informazioni accurate quando si imbattono in contenuti di dubbia provenienza.Utilizzo di Modelli di Linguaggio di Grandi Dimensioni per la Moderazione dei ContenutiClegg ha anche discusso l’uso di Ai generativa da parte di Meta come strumento per aiutare a far rispettare le proprie politiche. “Stiamo usando i LLM per rimuovere i contenuti in determinate circostanze. In questo modo, i nostri revisori possono concentrarsi sui contenuti che hanno maggiori probabilità di violare le nostre regole”.